Optimisation automatique

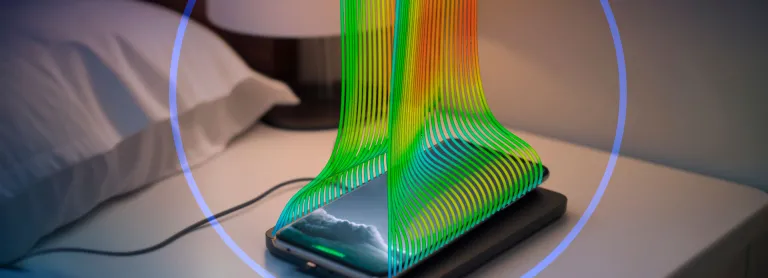

Utiliser des routines d'optimisation automatiques destinées aux équipements et systèmes électromagnétiques avec CST Studio Suite

Paramétrage et optimisation avec CST Studio Suite

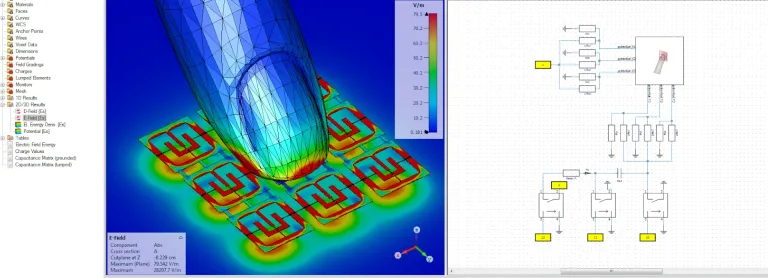

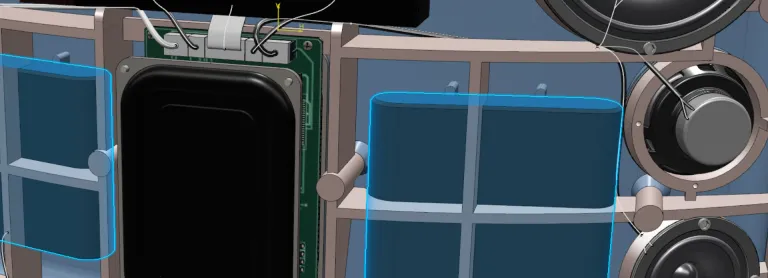

Paramétrage des modèles de simulation

Les modèles CST Studio Suite peuvent être paramétrés en fonction de leurs cotes géométriques ou des propriétés des matériaux. Vous pouvez introduire des paramètres à tout moment, pendant le processus de modélisation ou de manière rétrospective. Les utilisateurs peuvent accéder à leur paramétrage via l'interface pour étudier le comportement d'un appareil à mesure que ses propriétés changent.

Études paramétriques et optimisation automatique

Grâce à l'étude paramétrique, les utilisateurs peuvent identifier les paramètres de conception optimaux afin d'obtenir l'effet souhaité ou d'atteindre l'objectif fixé. Ils peuvent également adapter les propriétés des matériaux pour que les modèles correspondent aux données mesurées.

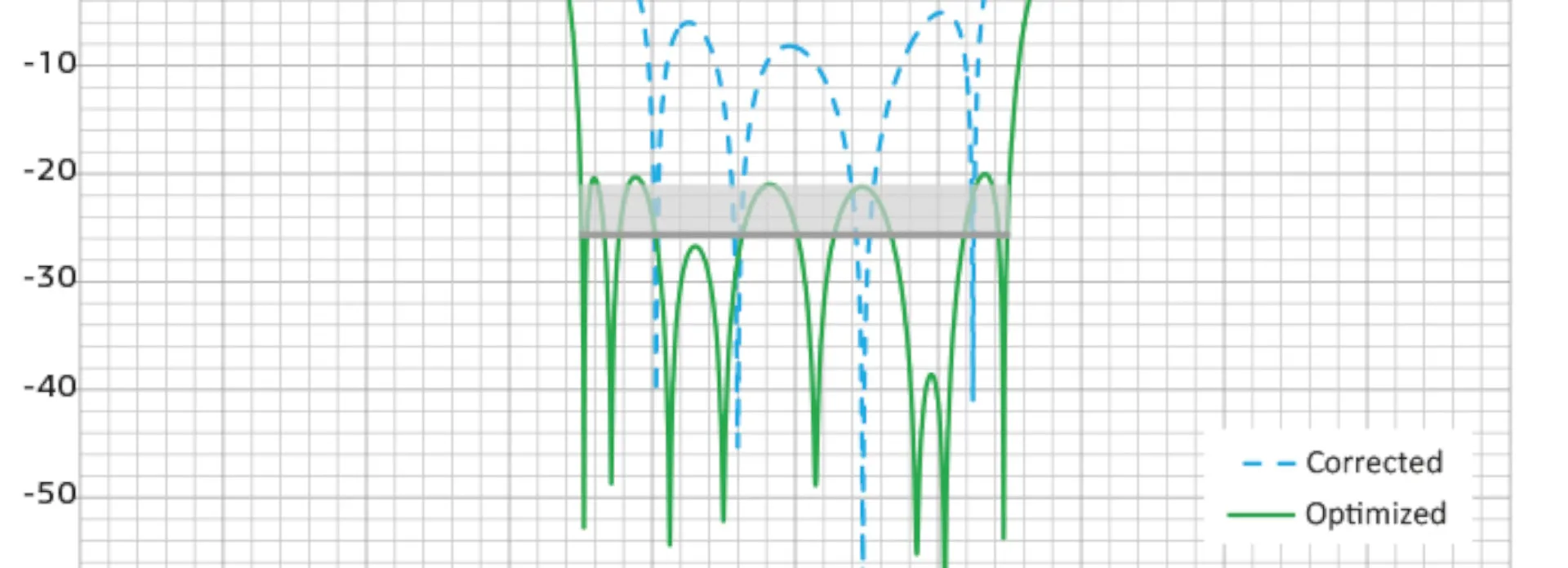

CST Studio Suite contient plusieurs algorithmes d'optimisation automatique à l'échelle locale et globale. Les optimiseurs locaux fournissent une convergence rapide mais locale, plutôt qu'une solution globale de meilleure qualité. D'un autre côté, les optimiseurs globaux effectuent des recherches sur la totalité de l'espace du problème, ce qui exige plus de calculs.

Optimisation plus rapide

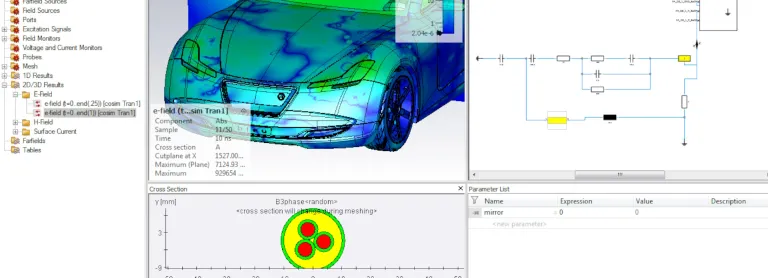

Le temps requis pour une optimisation dépend du délai de résolution de chaque simulation électromagnétique, mais aussi du nombre d'itérations requises pour parvenir à la solution optimale. Il est possible d'utiliser des techniques de calcul haute performance pour faciliter la simulation et l'optimisation de systèmes très complexes ou de problèmes présentant de nombreuses variables.

Les optimiseurs globaux et les études paramétriques indépendantes offrent de meilleures performances lorsqu'il est possible d'exécuter des ensembles distincts en parallèle. L'informatique distribuée peut considérablement améliorer les performances de ces applications.

Optimiseurs CST Studio Suite

À découvrir également

Découvrir comment SIMULIA peut vous aider

Contactez un expert SIMULIA pour découvrir comment nos solutions permettent une collaboration transparente et une innovation durable dans des entreprises de toutes tailles.

Commencer

Des formations et des cours sont disponibles pour les étudiants, le monde académique, les professionnels et les entreprises. Trouvez la formation SIMULIA qui vous convient.

Obtenir de l'aide

Obtenez des informations sur la certification des logiciels et du matériel, les téléchargements de logiciels, la documentation utilisateur, les coordonnées du support et l'offre de services.